最近注目が集まっている機械学習ライブラリのPytorch Lightningですが、

・PyTorch Lightningがどんなものなのかわからない

・PyTorch Lightningの学習コストはどのくらいなのか知りたい

と考える方は多いのではないでしょうか。そこでこの記事では、

・PyTorch Lightningの概要や導入するメリット

・PyTorch Lightningの実装例とPyTorchとのコード比較

・PyTorch Lightningのおすすめの学習方法

についてわかりやすく解説します。

\文字より動画で学びたいあなたへ/

Udemyで講座を探す >INDEX

PyTorch Lightningとは?

PyTorch Lightning(パイトーチライトニング)は、オープンソースの機械学習ライブラリ「PyTorch(パイトーチ)」を基盤として作られた高レベルのフレームワーク(ラッパー)です。

PyTorchは、TensorFlow(テンサーフロー)と並び、機械学習・深層学習のライブラリ・フレームワークとして2強の一角を担っています。しかし、PyTorchは低レベルAPIで慣れるまで難しいと感じるかもしれません。そこで、より効率的に開発するために登場したものがPyTorch Lightningです。

PyTorch Lightningは、直感的にコードを書けることや、コミュニティが活発で必要な情報が手に入れやすいといった特徴があります。また、PyTorch Lightningを使用することで、コードの簡略化やさまざまな機能が利用でき、拡張性も高いです。

PyTorchのラッパーとしては、PyTorchが開発する公式の「Ignite」もありますが、サードパーティー製であるPyTorch Lightningの方が評価は高く、現場で使用されることが多くなっています。

PyTorchについて詳しくは、「【入門編】PyTorchとは何か?インストールから実装までわかりやすく解説」をご覧ください。

\文字より動画で学びたいあなたへ/

Udemyで講座を探す >PyTorch Lightningを導入するメリット

PyTorchは、自由度が高く柔軟な記述が可能ですが、その反面、可読性が低下する傾向があります。また、モデルの学習やデータの精査などの「サイエンス」と直接関係のないコード記述に時間を割かれたり、高度なコーディング能力が求められたりすることがあります。

PyTorch Lightningを利用することで、PyTorchのデメリットをカバーしつつ、さらなる機能も活用できるようになります。主なメリットは以下の通りです。

ここからは、それぞれのメリットを解説します。

コード記述の簡略化

PyTorch Lightningを使用すると、機械学習を進める上で必要なコーディングを一部簡略化して利用することが可能です。フレームワークを埋めるように記述するため、書き方がわかりやすくなります。

ある程度の制約があることで、逆に書きやすさが向上する面もあります。例えば、トレーニングループやバリデーションループなどの定型的なコードを書く必要がなくなり、モデルの定義や学習プロセスに集中することが可能です。

追加機能の使用が容易

PyTorch Lightningでは、モデルの保存やトレーニングの進捗の表示といった汎用性の高い追加機能が豊富に用意されており、数行のコードで実装することが可能です。これらの機能を簡単に利用できるため、開発効率が大幅に向上します。

例えば、自動的な学習率の調整、早期停止(Early Stopping)、モデルのチェックポイント保存などが容易に実装できます。

クラウドでの実装

PyTorch LightningはAccelerator API(アクセラレーションエーピーアイ)を通じて、CPU・GPU・TPU・Horovodなどのハードウェアをサポートしています。通常、これらのハードウェアをうまく使い分けるためには複雑なコードが必要ですが、PyTorch Lightningを使用することで、簡易化できます。さらに、TPUサポートは外部ライブラリを必要とせず、PyTorch Lightningに組み込まれているため、クラウド上での実装が容易になります。

また、クラウド上で大規模なモデルを効率的に学習させることも可能です。クラウドでの実装が簡単になることでスケーラビリティが向上し、より大規模な機械学習プロジェクトにも対応しやすくなるでしょう。

今後AWS・GCP・Azureなどのクラウドサービスとの連携を強化する予定であり、クラウドでの実装がより強化される見込みです。(2024年10月現在)

データサイエンスのための PyTorch Lightningによる 実践 深層学習

プロレベルの深層学習スキルを学ぼう。Computer VisionとNLPが両方学べます。

\無料でプレビューをチェック!/

講座を見てみるPyTorch Lightningの実装例とPyTorchとのコード比較

ここからは、実際にPyTorch Lightningでの実装例をみてみましょう。PyTorchでの実装例とも比較し、どのような違いがあるのかも解説します。

PyTorch Lightningの実装例

サンプルコードは、基本的な画像分類モデルの実装例です。PyTorch Lightingでは、モデル定義・トレーニングステップ・データローダーの設定が1つのクラス内にまとめられています。こうすることでコードの構造が明確になり、再利用性が向上します。

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 |

# coding:cp932 import lightning as L import torch import torch.nn as nn import torch.optim as optim from torchvision import datasets, transforms from torch.utils.data import DataLoader class LightningNet(L.LightningModule): def __init__(self): super().__init__() self.fc = nn.Linear(28 * 28, 10) def forward(self, x): return self.fc(x.view(x.size(0), -1)) def training_step(self, batch, batch_idx): data, target = batch output = self(data) loss = nn.functional.cross_entropy(output, target) self.log('train_loss', loss) return loss def configure_optimizers(self): return optim.Adam(self.parameters()) def train_dataloader(self): transform = transforms.ToTensor() dataset = datasets.MNIST(root='./data', train=True, download=True, transform=transform) return DataLoader(dataset, batch_size=64, shuffle=True) # モデルのトレーニング model = LightningNet() trainer = L.Trainer(max_epochs=5, accelerator="auto", devices="auto") trainer.fit(model) |

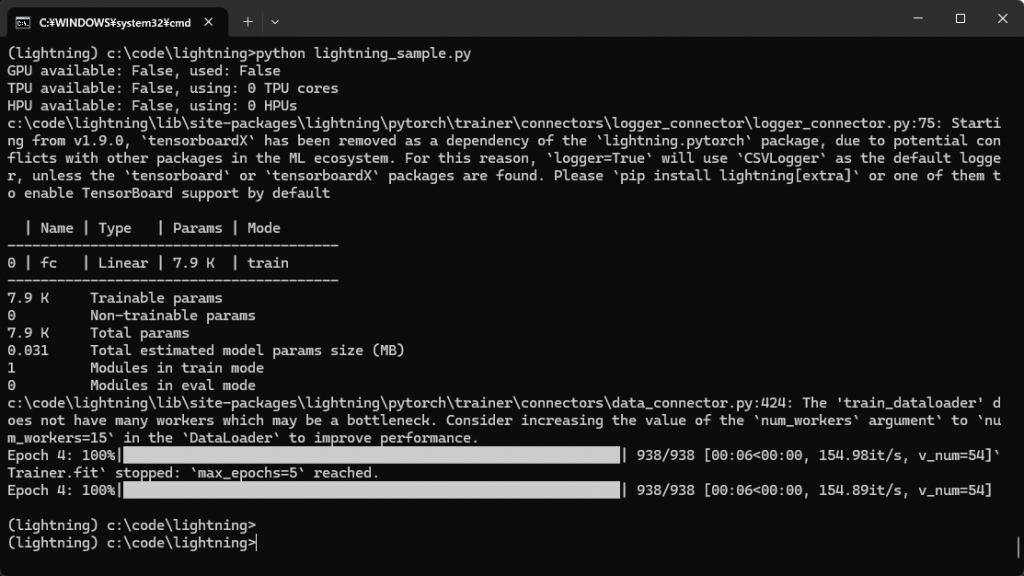

実行結果:

ハードウェアの情報やモデル構造・パラメータ数、進行状況、パフォーマンス指標などがわかりやすく出力されます。また、デフォルトで学習のチェックポイント(ckptファイル)も、「lightning_logs」配下に自動的に保存されます。

バリデーションのlossが少ないモデルを保存したい、定期的にモデルを保存したいという場合には「ModelCheckpoint」を利用することも可能です。

そのほか、過学習を避けるための「Early Stopping(早期終了)」も標準機能として用意されており、「EarlyStopping」としてLightning Trainerに組み込むことで簡単に利用できます。

なお、上記の実行結果ではいくつか警告が出力されていますが、これは環境によるものであり結果には影響していません。

PyTorchとのコード比較

PyTorchで基本的な画像分類モデルを実装する場合のサンプルコードは次の通りです。

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 |

# coding:cp932 import torch import torch.nn as nn import torch.optim as optim from torchvision import datasets, transforms # モデル定義 class SimpleNet(nn.Module): def __init__(self): super().__init__() self.fc = nn.Linear(28 * 28, 10) def forward(self, x): return self.fc(x.view(x.size(0), -1)) # データ準備 transform = transforms.ToTensor() train_dataset = datasets.MNIST(root='./data', train=True, download=True, transform=transform) train_loader = torch.utils.data.DataLoader(train_dataset, batch_size=64, shuffle=True) # モデル、損失関数、オプティマイザの設定 model = SimpleNet() criterion = nn.CrossEntropyLoss() optimizer = optim.Adam(model.parameters()) # トレーニングループ for epoch in range(5): for batch_idx, (data, target) in enumerate(train_loader): optimizer.zero_grad() output = model(data) loss = criterion(output, target) loss.backward() optimizer.step() if batch_idx % 100 == 0: print(f'Epoch {epoch}, Batch {batch_idx}, Loss: {loss.item()}') |

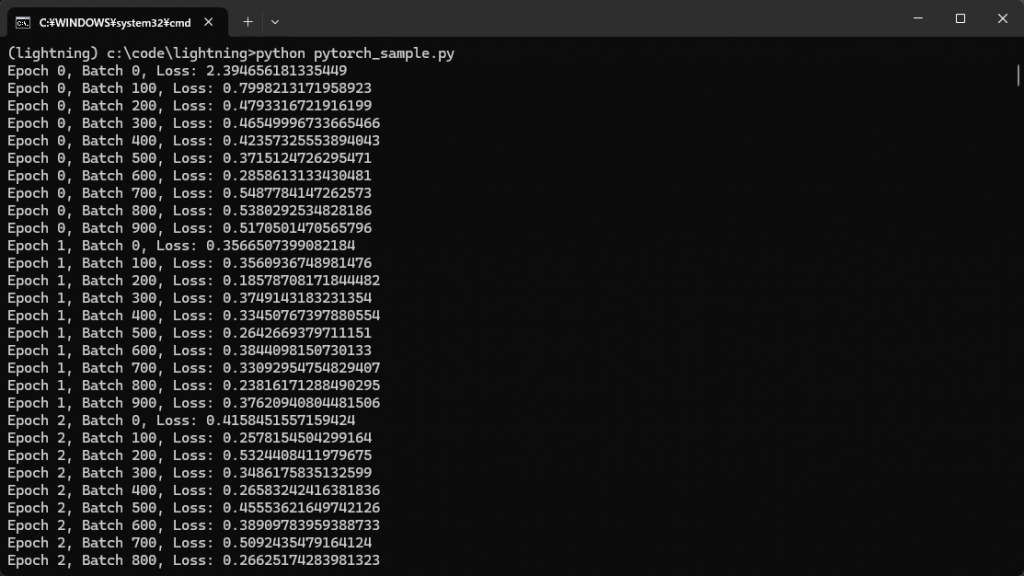

実行結果:

PyTorchでも比較的シンプルにまとめられていますが、PyTorch Lightningの方がよりわかりやすく、まとまっているのがわかるでしょう。

例えば、PyTorchではトレーニングループを記載しなければなりませんが、PyTorch LightingではLightning Trainerが代わりを担っています。この点もPyTorch Lightningのほうが簡略化できています。

実行結果を見ても、PyTorch Lightningと比べるとPyTorchの情報量は多くありません。実行結果の出力もトレーニングループのなかで行っていますが、PyTorch Lightningと同様の出力をしようとした場合、その分記載するコードも多くなってしまいます。

PyTorch Lightningのおすすめの学習方法

PyTorch Lightningを学習する場合、PyTorchの基礎知識も必要になるため学習コストは低くありません。しかし、効果的な学習方法を選ぶことで効率よく習得することは可能です。ここでは、PyTorch Lightningを学ぶための最適な方法をご紹介します。

公式サイトで学習する

PyTorch Lightningの公式サイトには、具体的な実装例をもとにしたチュートリアルが豊富に用意されています。チュートリアルは、初心者から上級者まで幅広いレベルに分け用意されており、段階的に学習を進めることが可能です。

例えば、基本的なモデル開発から始まり、検証セットやテストセットの追加、スクリプトパラメータの有効化など、順を追って学べるようになっています。また、公式サイトではサンプルコードが多数公開されているため、実際のコードを見ながら学習を進められます。

動画で学習する

PyTorch Lightningの公式サイトは情報が豊富ですが、日本語訳がないことが欠点です。その点、動画講座であれば日本語で学習を進められるため、非常に効果的な学習方法といえます。

動画講座では、PyTorch Lightningを使用するために必要な基礎知識から、より高度なテクニックまで包括的に学ぶことができます。特に、モデルの構築から学習、評価までの一連の流れを視覚的に理解できるため、実装の全体像を掴みやすい点は大きなメリットの一つです。

ほかにも、講師の説明を聞きながら、実際のコーディングプロセスを見られることもメリットです。コードの書き方だけでなく、デバッグの方法や、よくある問題の解決方法なども学べます。公式サイトでの学習と比較すると、動画学習はより情報量が多く視覚的な学習が可能です。そのため、特に初心者の方には動画学習をおすすめします。

PyTorch Lightningで機械学習を実装しよう

PyTorch Lightningは、PyTorchを基盤として作られた高レベルのフレームワーク(ラッパー)です。PyTorch Lightningを利用することで、コード記述を簡略化でき、追加機能も容易に使用できるようになります。

また、クラウドでの実装も容易になる点も特徴の一つです。PyTorch LightningはPyTorchの基本から理解しておかなければならないため、学習コストが低いとはいえません。公式サイトではサンプルコードなども多数用意されていますが、すべて英語であるため習得には時間が掛かるでしょう。

しかし、Udemyでは日本語でPyTorch Lightningの基本から実践的な深層学習を学べる動画講座を用意しています。

以下の講座は、「PyTorch Lightningを用いた深層学習の基礎を身につけたい」「深層学習の基礎から発展まで包括的に学びたい」と考える方におすすめの講座ですので、この機会にぜひ確認してみてはいかがでしょうか。

下記講座のレビューの一部をご紹介

評価:★★★★★

コメント:pytorch lightningは、あまり馴染みがありませんでしたが、コードをよりシンプルに記述できることが理解できました。また、LLMのファインチューニングでは、最終層付近のパラメータのみを学習する方法で実施していましたが、別のモデルを追加する方法があることを初めて知り、参考になりました。

評価:★★★★★

コメント:このコースは、実務に役立つ深層学習の応用能力を身につけるうえで非常に有益でした。特に、PyTorch Lightningを用いたモデル構築や、TransformerやGPTといったNLPのコーディングを学べたことが大きな成果です。また、リソースが実用的で素晴らしく、講義資料や使用可能なコードブックを通じて、実際のデータサイエンスプロジェクトに応用できる実践的な知識と基礎を習得できました。深層学習の実践を目指す方に広くおすすめできる内容です。

PyTorch Lightningでコーディングを簡略化し、深層学習への理解を深めましょう。

最新情報・キャンペーン情報発信中