近年、AIを支える機械学習技術の一つとして注目を集めているRNN(リカレントニューラルネットワーク)。

文章解析・生成だけではなく、機械翻訳や音声認識、画像分析にも広く用いられていることから、システム開発に取り入れようと検討してはいるものの、

・具体的に何ができるのか知りたい…。

・基本的な仕組みを理解して活用したい…。

という方も多いのではないでしょうか。そこでこの記事では、

・RNNの概要や基本的な仕組み

・RNNの活用方法や具体的な使い方

についてご紹介します。初心者の方でも、この記事を読めば基本的な知識や仕組みなど、RNNについての理解が深まります。

\文字より動画で学びたいあなたへ/

Udemyで講座を探す >INDEX

RNN(リカレントニューラルネットワーク)とは

RNNとは「Recurrent Neural Network(リカレントニューラルネットワーク)」を略した言葉です。具体的には内部に循環を持つニューラルネットワークの総称「再帰型ニューラルネットワーク」のことです。

数値の時系列データやシーケンシャルデータ(連続的なデータ)のパターンを認識するように設定されたニューラルネットワークのモデルとして注目され、近年では自然言語処理において成果を挙げているアルゴリズムです。

そんなRNNは「入力層」、「隠れ層」、「出力層」の3層から構成されているニューラルネットワークで、これまでに入力された情報を利用することで、将来的に入力されるデータにおけるネットワーク性能を向上させるディープラーニングのアーキテクチャ(倫理的構造)です。

これまでのニューラルネットワークでは、インプット・アウトプットデータはそれぞれ独立していると言う考え方が一般的でした。しかしAIをより広い分野で活用するためには、より人間に近しい論理的な予測能力を備えたアルゴリズムが必要です。

RNNはインプット・アウトプットされた時系列データや文章、シーケンシャルデータなどの連続的なデータを認識し、それらのパターンを用いて今後入力されるデータに対して予測を行います。

入力されるデータを予測することで、画像認識や動画解析、機械翻訳などの処理を高い精度で実現できるようになりました。

ニューラルネットワークやディープラーニングについて、より詳しく理解したい方は「ニューラルネットワークとは?人工知能の基本を初心者向けに解説!」や「話題のディープラーニングとは?初心者向けに1から徹底解説!」の記事をご覧ください。

\文字より動画で学びたいあなたへ/

Udemyで講座を探す >RNNの特徴やできること

RNNの特徴やできることは主に以下の3つです。

・信号処理ができる

・文章・画像解析ができる

・機械翻訳ができる

こからは、RNNのそれぞれの特徴について紹介します。

信号処理ができる

RNNは、大規模な信号データセットに対して、自動分類や自動回帰を用いることによって、リアルタイムでの予測を実現しています。これにより音声認識を実現し、スマートスピーカーなどで活用されています。

音声データは、センサーを通して集められるため、時系列のシーケンシャルデータ(連続的なデータ)となります。例えば、スマートスピーカーでは、人が発した言葉を理解したうえでの対応が要求されます。しかし、音声でのインプットやテキストでのアウトプットは、共に長さや桁数、文字数、データの大きさが定まっていないことから、文脈への高い理解力に加え、予測・処理し、適切に対応する能力が必要です。

つまり、時系列データの処理能力が必要不可欠なため、RNNが音声データを時系列に処理することで、実現している技術といえます。

文章・画像解析ができる

文章や画像データの解析ができるのもRNNが持つ特徴の一つです。日本語や英語をはじめとした自然言語で書かれた文章を解析し、書かれている内容を認識することができます。

RNNでは、対応する文章を生成するのはもちろんのこと、多くの学習データを読み込ませることで、単語やフレーズの意味の分類し、文章のパターンをモデル化することも可能です。自然言語処理タスクに適したツールと言えるでしょう。

さらに画像でもピクセルデータを自然言語のような連続データとして解析することで、何が表示されているか把握し、画像内の文字を読み取るなどの処理ができます。

これらの能力を活かし、自動返信のチャットや手書き文字の読み込み機能、文章などに対応した画像キャプションの自動生成など、様々な分野でRNNの技術が応用されています。

機械翻訳ができる

RNNは、自然言語処理能力を活かし、Google翻訳をはじめとした翻訳システムやアプリケーションに使われることが多いのも特徴です。

翻訳では入力されたデータの意味の理解はもちろんのこと、前後の文章のつながりや連続した言葉の中における次の言葉の出現確率を予測し、別の言語の文章として出力する能力も必要とされます。

機械翻訳が前述の文章解析と異なる点は、インプットデータを読み込んだうえでアウトプットデータを処理するため、あらかじめ完全な文章を入力する必要があります。これにより、翻訳の場合でもより自然な言い回しの文章を出力することが可能となります。

RNNとLSTM(Long Short Term Memory)との違い

LSTMは「Long Short Term Memory(長・短期記憶)」の略で、通常のRNNを大きく改善したモデルのことです。

両者のアルゴリズムは、基本的には同じ構造をしているものの、入力、出力の中間に位置する隠れ層を計算するのに異なる関数を用いているのが特徴です。

LSTMは内部ゲート構造があるため、RNNとは異なり情報の取捨選択が行えます。それにより、LSTMはシーケンスデータの長期的依存関係の効率的な学習を実現したのです。

その結果としてLSTMでは、情報の時系列において遠く離れた言葉同士に適切な関係性を持たせることができます。

LSTMは、RNNと似ているものの、長期的依存性問題を解決させるために改良・開発されたモデルです。

RNNの仕組み

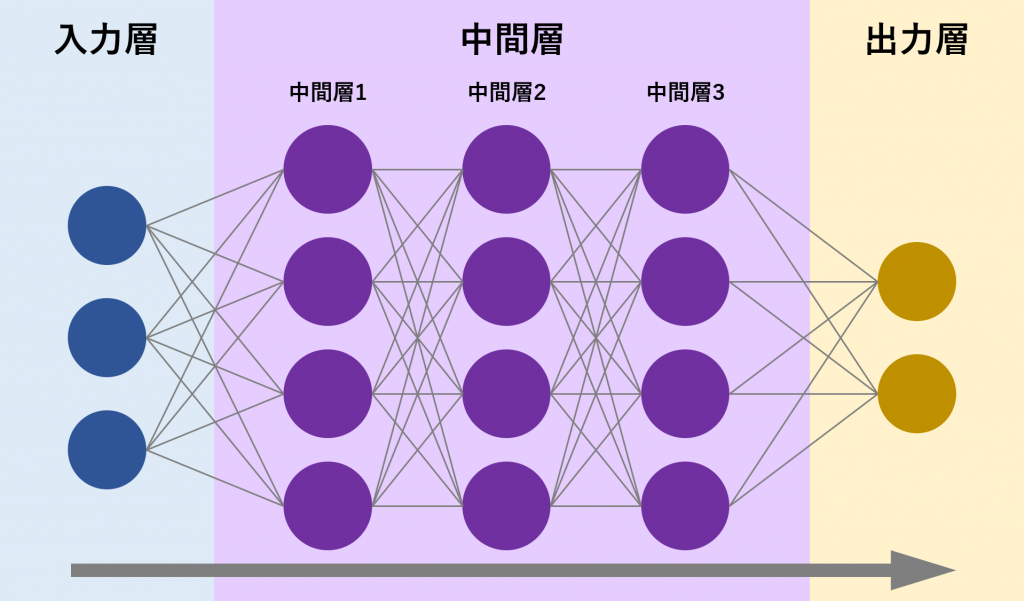

RNNは、ニューラルネットワークの中でも、より深い階層に適応させることでディープラーニングに用いられるDNN(ディープニューラルネットワーク)の種類の1つです。

一般的に、DNNには2層以上の中間層があるニューラルネットワークとされています。DNNでは入力された情報を、中間層1、2、3のように、順序にしたがって移動させるため、2や3の演算結果が1や2など、前の中間層で再演算されることはありません。

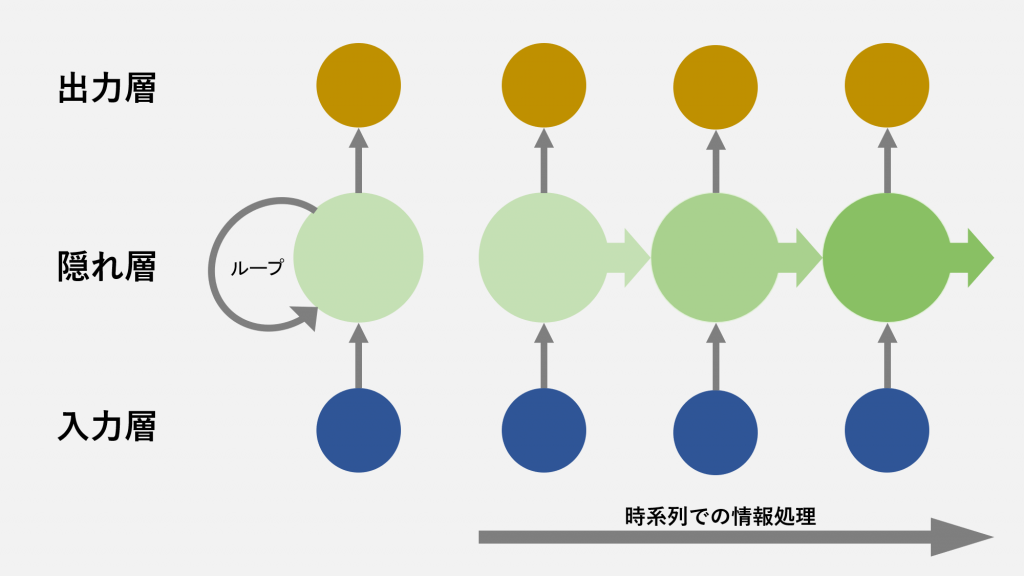

一方、RNNは前述の通り「入力層」、「隠れ層」、「出力層」の3層から構成されるニューラルネットワークです。中間層が1層のRNNがDNNに分類されている要因は、その再演算を繰り返し行うことによって中間層を何度も使用する演算のプロセスにあります。

RNNは、ネットワーク構造に隠れ状態とループを含むのが特徴です。DNNとは異なり、中間層の演算結果を出力層に移動させて出力するとともに、同じ演算結果を中間層に入力し、再演算を行う仕組みです。

そして、中間層での出力を再び中間層に入力する際、現在の代入回数つまり時間軸を明確にする必要があります。RNNでは、過去の情報を隠れ状態で保存し、再演算時にそれを中間層に入力することによって、その情報に基づいた時系列での情報処理を実現しているのです。

RNNの使い方

ここではRNNの実装例として、Pythonを用いた基本的なコード例を紹介します。

Pythonコード例

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 48 49 50 51 52 53 54 55 56 57 58 59 60 61 62 63 64 65 66 67 |

import torch import torch.nn as nn import torch.optim as optim # 文字を整数にマッピング char_to_ix = {ch: i for i, ch in enumerate('abcdefghijklmnopqrstuvwxyz')} ix_to_char = {i: ch for ch, i in char_to_ix.items()} # RNNモデルの定義 class RNN(nn.Module): def __init__(self, input_size, hidden_size, output_size): super(RNN, self).__init__() self.hidden_size = hidden_size self.i2h = nn.Linear(input_size + hidden_size, hidden_size) self.i2o = nn.Linear(input_size + hidden_size, output_size) self.softmax = nn.LogSoftmax(dim=1) def forward(self, input, hidden): combined = torch.cat((input, hidden), 1) hidden = torch.tanh(self.i2h(combined)) output = self.i2o(combined) output = self.softmax(output) return output, hidden def initHidden(self): return torch.zeros(1, self.hidden_size) # ハイパーパラメータ n_hidden = 128 n_epochs = 1000 lr = 0.005 # モデルの初期化 n_chars = len(char_to_ix) rnn = RNN(n_chars, n_hidden, n_chars) optimizer = optim.Adam(rnn.parameters(), lr=lr) criterion = nn.NLLLoss() # 学習データ data = "hello world" # 学習ループ for epoch in range(n_epochs): loss = 0 hidden = rnn.initHidden() for i in range(len(data) - 1): input = torch.zeros(1, n_chars) input[0][char_to_ix[data[i]]] = 1 target = torch.tensor([char_to_ix[data[i+1]]], dtype=torch.long) output, hidden = rnn(input, hidden) loss += criterion(output, target) loss.backward() optimizer.step() optimizer.zero_grad() if epoch % 100 == 0: print(f'Epoch {epoch}, Loss: {loss.item():.4f}') # テキスト生成 def generate(start_char, n): with torch.no_grad(): hidden = rnn.initHidden() input = torch.zeros(1, n_chars) input[0][char_to_ix[start_char]] = 1 output_string = start_char for _ in range(n): output, hidden = rnn(input, hidden) prob = output.exp() char_index = torch.multinomial(prob, 1).item() predicted_char = ix_to_char[char_index] output_string += predicted_char input = torch.zeros(1, n_chars) input[0][char_index] = 1 return output_string # 生成されたテキストの表示 print(generate('h', 20)) |

コードの各部分がどのような意味や役割を持つかは以下の通りです。

#文字を正数にマッピング

このフローではデータの準備を行います。アルファベットの小文字を文字から整数へ、整数から文字へマッピングする辞書を作成します。

#RNNモデルの定義

入力層、隠れ層、出力層を定義しています。forwardメソッドは、入力と前の隠れ状態を受け取り、次の文字の予測と新しい隠れ状態を返します。

#ハイパーパラメータ

隠れ層のサイズ、エポック数、学習率などを設定します。

#モデルの初期化

RNNモデル、オプティマイザ、損失関数を初期化します。

#学習データ及び#学習ループ

学習データ、ループは”hello world”という文字列を使って、モデルを訓練します。各文字を入力として、次の文字を予測するようにモデルを学習させます。

#テキスト生成

使用しているgenerate関数は学習したモデルを用いて、指定された開始文字から新しいテキストを生成します。

#生成されたテキストの表示

結果の表示は’h’から始まる20文字のテキストを生成し、表示します。

上記のコード例は、Pythonを用いたコードです。あくまでコードサンプルなので、目的や環境に応じて適宜カスタマイズしてください。

RNNを使って深層学習を試してみよう!

RNNは、内部に循環を持つ「入力層」、「隠れ層」、「出力層」の3層から構成されるニューラルネットワークの総称「再帰型ニューラルネットワーク」のことです。

具体的には、インプット・アウトプットされた時系列データや文章、シーケンシャルデータをはじめとした連続的なデータを認識し、それらのパターンを利用することで将来的に入力されるデータに対して予測を行い、ネットワーク性能を向上させるディープラーニングのアーキテクチャです。

近年、画像認識や動画解析、機械翻訳をはじめとした様々な分野で幅広く活用され、AIを支える機械学習技術の一つとして注目を集めています。

そんなRNNの特徴は、信号処理ができること、文章・画像解析ができること、機械翻訳ができることの3つです。

RNN(自然言語処理)を効率よく学びたい方には、以下の講座がおすすめです。

③米国AI開発者がやさしく教える深層学習超入門第三弾(自然言語処理)【Pythonで実践】

自然言語処理の深層学習の基礎(RNN)

\無料でプレビューをチェック!/

講座を見てみるレビューの一部をご紹介

評価:★★★★★

わかりやすいです。

評価:★★★★★

自然言語処理で注目されるRNNに関して、実際にコードを書いて解説してくれているので、アルゴリズムのイメージをつかみやすいと感じております。

基本的な知識や仕組みを理解し、AIシステム開発に取り入れてみましょう。

最新情報・キャンペーン情報発信中